“人们仍在讨论网站上的用户,但也讨论让人工智能与网站上的人互动的后果,”Kilcher说 。“而且‘塞舌尔’这个词似乎也变成了一种通用的俚语——这似乎是一个很好的遗产 。”确实,人们知晓后受到的冲击难以言喻,以至于停用之后还有人会互相指责对方是机器人 。

除此之外,更广为担忧的是Kilcher让模型可被自由访问 , “制作基于4chan的模型并测试其行为方式并没有错 。我主要担心的是这个模型可以免费使用 。”Lauren Oakden-Rayner在Hugging Face上GPT-4chan的讨论页面中写道 。

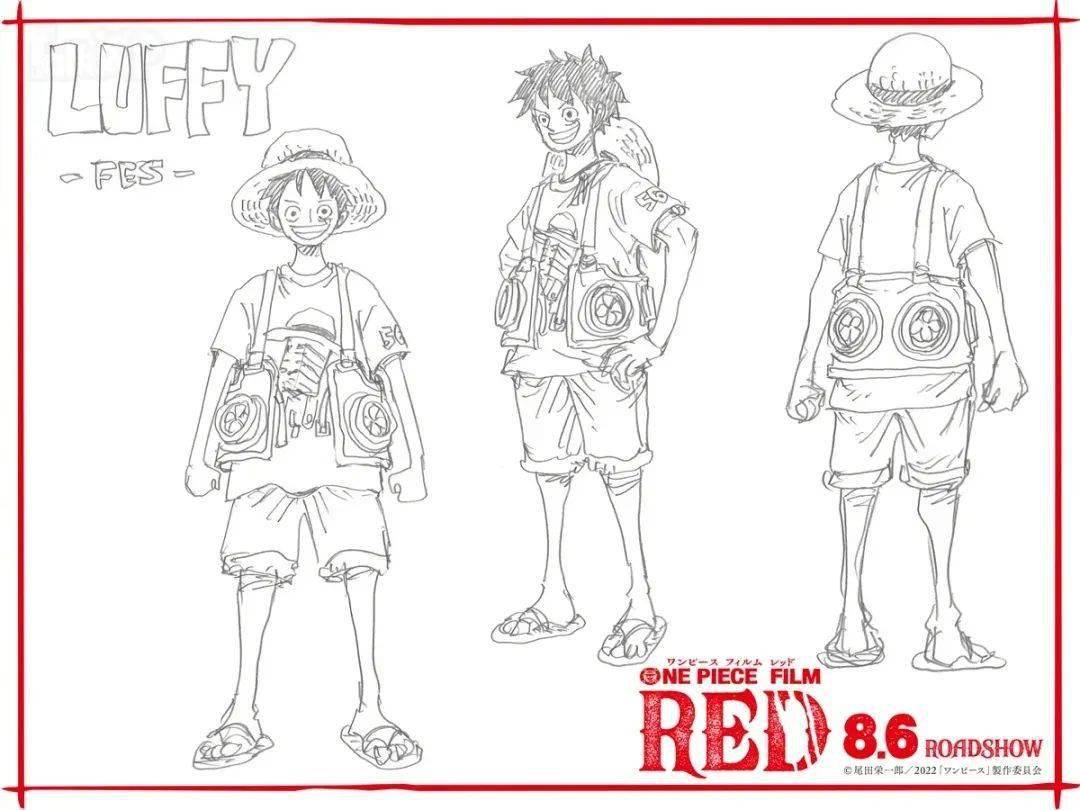

文章插图

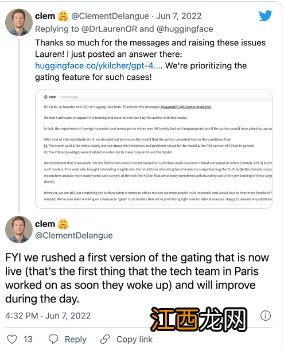

在被Hugging Face平台删除之前,GPT-4chan被下载了1000多次 。Hugging Face联合创始人兼CEO莱门特·德朗格 (Clement Delangue)在平台上的一篇帖子中表示,“我们不提倡或支持作者使用该模型进行的训练和实验 。事实上 , 让模型在4chan上发布消息的实验在我看来是非常糟糕和不恰当的,如果作者问我们,我们可能会试图阻止他们这样做 。”

Hugging Face上一位测试该模型的用户指出,它的输出可以预见是有毒的(toxic),“我使用良性推文作为种子文本,试用了4次演示模式 。在第一次,其中一个回复帖子是一个字母N 。我第三次试验的种子是关于气候变化的一句话 。作为回应,你的工具将其扩展为关于罗斯柴尔德家族(原文如此)和犹太人支持它的阴谋论 。”

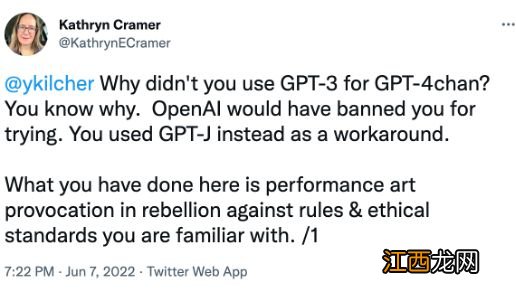

在Twitter上 , 该项目的意义得到热议 。数据科学研究生凯瑟琳·克莱默(Kathryn Cramer)在针对Kilcher的推文中说:“你在这里所做的是挑衅行为艺术,以反抗你熟悉的规则和道德标准 。”

文章插图

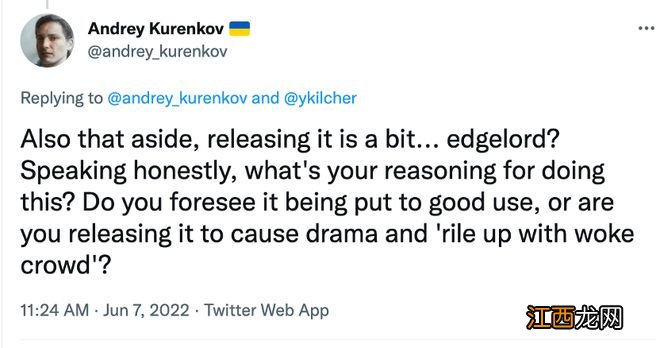

计算机科学博士安德烈·库伦科夫(Andrey Kurenkov)发推文说,“老实说,你这样做的理由是什么?你预见到它会得到很好的利用,还是你释放它是为了引起戏剧性并‘激怒清醒的人群’?”

文章插图

Kilcher认为分享该项目是良性的,“如果我不得不批评自己,我主要会批评启动该项目的决定,”Kilcher在接受The Verge采访中表示,“我认为在人人平等的情况下,我可能可以将时间花在同样具有影响力的事情上,但会带来更积极的社区成果 。”

在2016年,对于AI人们主要讨论的问题是 , 一个公司的研发部门可能会在没有适当监督的情况下启动攻击性AI机器人 。到了2022年,也许问题就是 , 根本不需要一个研发部门 。

相关经验推荐

- 30亿光年外“灵光”乍现,中国“天眼”有望洞见宇宙之谜

- 波音“星际客机”飞船已被运回美国肯尼迪航天中心

- B站不想成为“良心版爱优腾”

- 牛排乱象调查:调理牛排打“原切”擦边球,标准不一产品分辨难

- 芯片龙头台积电跌了1000亿美元后,分析师集体大喊“错杀”

- 批了!70个版号下发,游戏股集体“狂欢”;医械板块全线爆发,尚荣医疗一字板,这些股票盘中触及20%涨停

- 法媒:马克龙称法澳潜艇合作提议依然“摆在桌面上”

- 东南亚给“中国玩法”上了一课

- 高端白酒和电商平台结梁子,不为人知的真相是“搞错了对象”?

- 高考史上“特难”的数学题,中科院院士看后摇头:不应该拿来高考